Một sản phẩm của BEACON MEDIA

Dữ liệu

New

Chuyên mục

Media

Báo cáo đặc biệt

Một sản phẩm của BEACON MEDIA

Khám phá nhiều hơn với tài khoản

Đăng nhập để lưu trữ và dễ dàng truy cập những bài viết bạn yêu thích trên Bloomberg Businessweek Việt Nam.

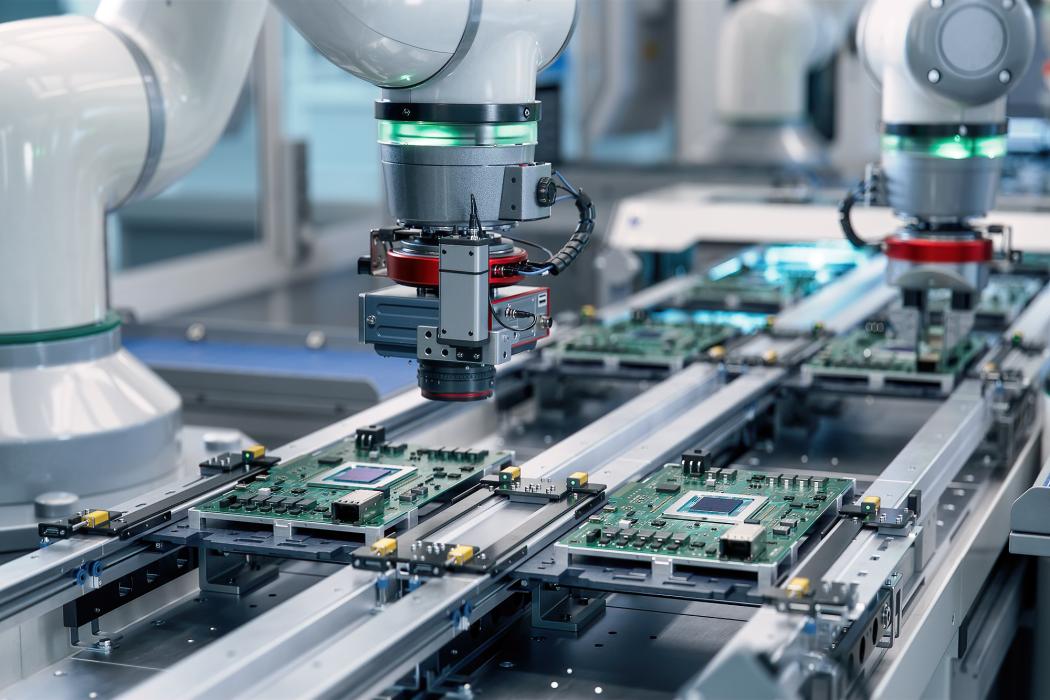

BBWV - Cuộc đua tự chủ hạ tầng trí tuệ nhân tạo (AI) sang giai đoạn mới khi các tập đoàn công nghệ lớn đồng loạt đẩy mạnh sản xuất phần cứng chuyên dụng.

Ảnh: Shutterstock

Tác giả: Minh Khoa tổng hợp

20 tháng 04, 2026 lúc 5:45 PM

Sự dịch chuyển này được đánh dấu bằng các kế hoạch phát triển chip bán dẫn nội bộ nhằm giảm bớt sự phụ thuộc vào các bộ xử lý đồ họa (GPU) truyền thống, đồng thời tối ưu hóa hiệu suất cho các mô hình ngôn ngữ lớn.

Alphabet, công ty mẹ của Google, đang trong quá trình đàm phán với hãng thiết kế chip Marvell Technology để phát triển hai dòng chip AI mới, theo Reuters. Động thái này nhằm mục tiêu vận hành các mô hình AI hiệu quả hơn và tạo ra một giải pháp đối trọng với sức mạnh thống trị của Nvidia trên thị trường.

Trong khuôn khổ hợp tác dự kiến, hai bên sẽ chế tạo một bộ xử lý bộ nhớ hoạt động song song với bộ xử lý tensor (TPU) hiện có của Google, cùng một thế hệ TPU hoàn toàn mới. Thiết kế của bộ xử lý bộ nhớ dự kiến hoàn tất sớm nhất vào năm 2027 trước khi bước vào giai đoạn sản xuất thử nghiệm. Thỏa thuận này không chỉ giúp Google tối ưu hóa chi phí đám mây mà còn mở rộng tệp khách hàng cho Marvell, trong bối cảnh các công ty điện toán đám mây quy mô lớn (hyperscaler) dự kiến chi thêm 100 tỷ USD cho hạ tầng trong năm nay.

Trên mặt trận sản xuất, Samsung Electronics chuẩn bị tổ chức lễ lắp đặt thiết bị tại nhà máy chip trị giá 17 tỉ USD ở Taylor, Texas vào ngày 24.4. Cơ sở này đang tiến gần đến giai đoạn vận hành để sản xuất chip AI cho Tesla dựa trên tiến trình 2 nanomet (2nm) tiên tiến.

Dự án tại Texas từng bị trì hoãn so với kế hoạch ra mắt ban đầu vào tháng 10.2024 do khó khăn trong việc tìm kiếm đơn hàng. Tuy nhiên, tiến độ đã được đẩy nhanh sau khi Samsung giành được hợp đồng trị giá 16,5 tỉ USD vào tháng 7.2025 để chế tạo chip AI5 và AI6 phục vụ hệ thống tự lái của Tesla. Tỉ phú Elon Musk hồi giữa tháng 4 cũng xác nhận dòng chip AI5 đã hoàn tất thiết kế (tape-out) và sẵn sàng cho quá trình sản xuất hàng loạt.

Trong phân khúc linh kiện hỗ trợ, SK hynix đã bắt đầu sản xuất hàng loạt mô-đun SOCAMM2 dung lượng 192GB. Sản phẩm này được xây dựng trên công nghệ LPDDR5X DRAM, thiết kế chuyên biệt cho nền tảng điện toán AI thế hệ mới Vera Rubin của Nvidia.

Mô-đun mới mang lại băng thông cao hơn và tiết kiệm năng lượng tốt hơn so với các chuẩn RDIMM cấp máy chủ thông thường, giúp giảm thiểu tình trạng nghẽn cổ chai dữ liệu trong quá trình huấn luyện AI. Thiết kế mô-đun có thể tháo rời cũng giúp quá trình sửa chữa và nâng cấp các hệ thống AI quy mô lớn trở nên dễ dàng hơn. Cạnh tranh trong lĩnh vực này đang diễn ra gay gắt khi Samsung tuyên bố đã khắc phục lỗi cong vênh và đưa mô-đun 192GB SOCAMM2 vào sản xuất, trong khi Micron đang thử nghiệm các mẫu 256GB cho phép mở rộng dung lượng lên tới 2TB trên mỗi CPU máy chủ.

Theo phattrienxanh.baotainguyenmoitruong.vn

https://phattrienxanh.baotainguyenmoitruong.vn/cuoc-dua-phan-cung-ai-nong-len-khi-google-dam-phan-voi-marvell-samsung-khoi-dong-nha-may-17-ti-usd-57383.html

Tặng bài viết

Đối với thành viên đã trả phí, bạn có 5 bài viết mỗi tháng để gửi tặng. Người nhận quà tặng có thể đọc bài viết đầy đủ miễn phí và không cần đăng ký gói sản phẩm.

Bạn còn 5 bài viết có thể tặng

Liên kết quà tặng có giá trị trong vòng 7 ngày.

BÀI LIÊN QUAN

Gói đăng ký